SFFAI 67 | 图表示学习专题《朱时超:图平滑样条神经网络》

SFFAI 66 | 诗歌生成专场《矣晓沅:基于学习可控混合隐空间的多样诗歌自动生成》

SFFAI 65 | 目标跟踪主题《许胤达:SiamFC++:视觉目标跟踪器设计的指导准则》

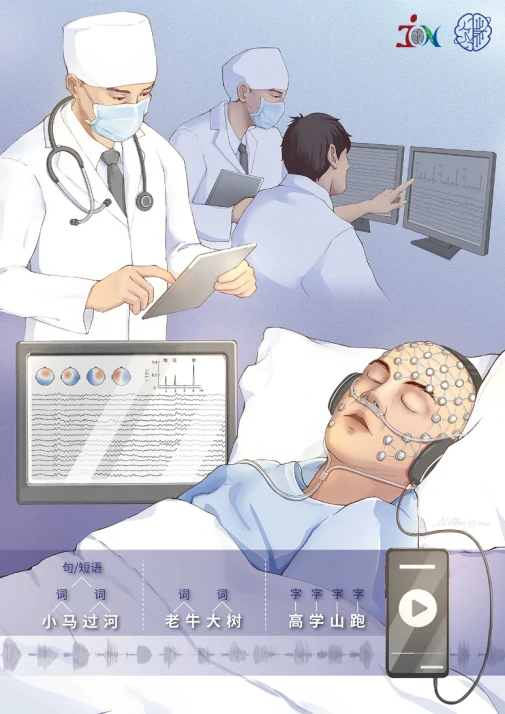

Nat Neurosci | 探索“植物人”语言能力和意识水平 | Assessing the depth of language processing in patients with disorders of consciousness | Nature Neuroscience | 中科院1区 IF 28.771

发表于 分类于 🌙进阶学习 , ⭐人工智能 Artificial Intelligence , 💫研究领域 Research Area , 🛰️脑机接口 Brain-computer Interface 阅读次数: Valine:

本文字数: 3.1k 阅读时长 ≈ 8 分钟

本文字数: 3.1k 阅读时长 ≈ 8 分钟